MixUp

مقدمه ای بر MixUp

یادگیری عمیق به عنوان یکی از حوزههای مهم هوش مصنوعی، همواره به دنبال راههای بهبود عملکرد مدلها و افزایش توانایی آنها در تعمیم به دادههای جدید بوده است. Mixup یکی از تکنیکهای نوآورانه در این زمینه است که به وسیله ترکیب تصاویر و برچسبها به شکل تصادفی، موجب افزایش تنوع دادههای آموزشی و بهبود توانایی مدل در تعمیم به دادههای ناشناخته میشود.

/*! elementor - v3.17.0 - 08-11-2023 */ .elementor-widget-image{text-align:center}.elementor-widget-image a{display:inline-block}.elementor-widget-image a img[src$=".svg"]{width:48px}.elementor-widget-image img{vertical-align:middle;display:inline-block} /*! elementor - v3.17.0 - 08-11-2023 */

.elementor-column .elementor-spacer-inner{height:var(--spacer-size)}.e-con{--container-widget-width:100%}.e-con-inner>.elementor-widget-spacer,.e-con>.elementor-widget-spacer{width:var(--container-widget-width,var(--spacer-size));--align-self:var(--container-widget-align-self,initial);--flex-shrink:0}.e-con-inner>.elementor-widget-spacer>.elementor-widget-container,.e-con>.elementor-widget-spacer>.elementor-widget-container{height:100%;width:100%}.e-con-inner>.elementor-widget-spacer>.elementor-widget-container>.elementor-spacer,.e-con>.elementor-widget-spacer>.elementor-widget-container>.elementor-spacer{height:100%}.e-con-inner>.elementor-widget-spacer>.elementor-widget-container>.elementor-spacer>.elementor-spacer-inner,.e-con>.elementor-widget-spacer>.elementor-widget-container>.elementor-spacer>.elementor-spacer-inner{height:var(--container-widget-height,var(--spacer-size))}.e-con-inner>.elementor-widget-spacer.elementor-widget-empty,.e-con>.elementor-widget-spacer.elementor-widget-empty{position:relative;min-height:22px;min-width:22px}.e-con-inner>.elementor-widget-spacer.elementor-widget-empty .elementor-widget-empty-icon,.e-con>.elementor-widget-spacer.elementor-widget-empty .elementor-widget-empty-icon{position:absolute;top:0;bottom:0;left:0;right:0;margin:auto;padding:0;width:22px;height:22px}

/*! elementor - v3.17.0 - 08-11-2023 */

.elementor-column .elementor-spacer-inner{height:var(--spacer-size)}.e-con{--container-widget-width:100%}.e-con-inner>.elementor-widget-spacer,.e-con>.elementor-widget-spacer{width:var(--container-widget-width,var(--spacer-size));--align-self:var(--container-widget-align-self,initial);--flex-shrink:0}.e-con-inner>.elementor-widget-spacer>.elementor-widget-container,.e-con>.elementor-widget-spacer>.elementor-widget-container{height:100%;width:100%}.e-con-inner>.elementor-widget-spacer>.elementor-widget-container>.elementor-spacer,.e-con>.elementor-widget-spacer>.elementor-widget-container>.elementor-spacer{height:100%}.e-con-inner>.elementor-widget-spacer>.elementor-widget-container>.elementor-spacer>.elementor-spacer-inner,.e-con>.elementor-widget-spacer>.elementor-widget-container>.elementor-spacer>.elementor-spacer-inner{height:var(--container-widget-height,var(--spacer-size))}.e-con-inner>.elementor-widget-spacer.elementor-widget-empty,.e-con>.elementor-widget-spacer.elementor-widget-empty{position:relative;min-height:22px;min-width:22px}.e-con-inner>.elementor-widget-spacer.elementor-widget-empty .elementor-widget-empty-icon,.e-con>.elementor-widget-spacer.elementor-widget-empty .elementor-widget-empty-icon{position:absolute;top:0;bottom:0;left:0;right:0;margin:auto;padding:0;width:22px;height:22px}

Mixup چیست؟

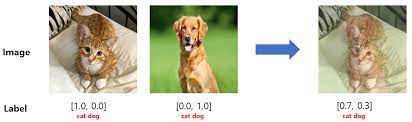

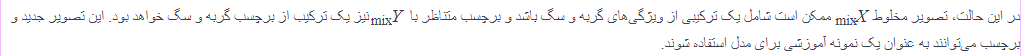

Mixup یک تکنیک افزایش داده است که توسط هوش مصنوعی و یادگیری عمیق مطرح شده است. ایده اصلی Mixup این است که به جای استفاده از تصاویر خام به عنوان ورودیهای شبکه عصبی، تصاویر و برچسبها به صورت ترکیبی از دو تصویر مختلف انتخاب شده وارد شوند. این ترکیب به صورت زیر انجام میشود:

تصویر=�×تصویر+(1−�)×تصویر دیگرتصویر=λ×تصویر+(1−λ)×تصویر دیگر

برچسب=�×برچسب+(1−�)×برچسب دیگربرچسب=λ×برچسب+(1−λ)×برچسب دیگر

در اینجا �λ یک عدد تصادفی از توزیع بتا است.

فواید Mixup

تضمین تنوع دادهها: Mixup با ایجاد ترکیبهای تصادفی از دادهها، باعث افزایش تنوع دادههای آموزشی میشود. این تنوع موجب بهبود توانایی مدل در تعمیم به دادههای ناشناخته میگردد.

کاهش افتراق نمونهها: Mixup با کاهش افتراق نمونهها در فضای ویژگی، موجب بهبود تشخیص مدل در مواجهه با دادههای نزدیک به یکدیگر میشود.

مقاومت در برابر تقلب (Adversarial Attacks): Mixup میتواند مقاومت مدل را در برابر حملات تقلبی افزایش دهد.

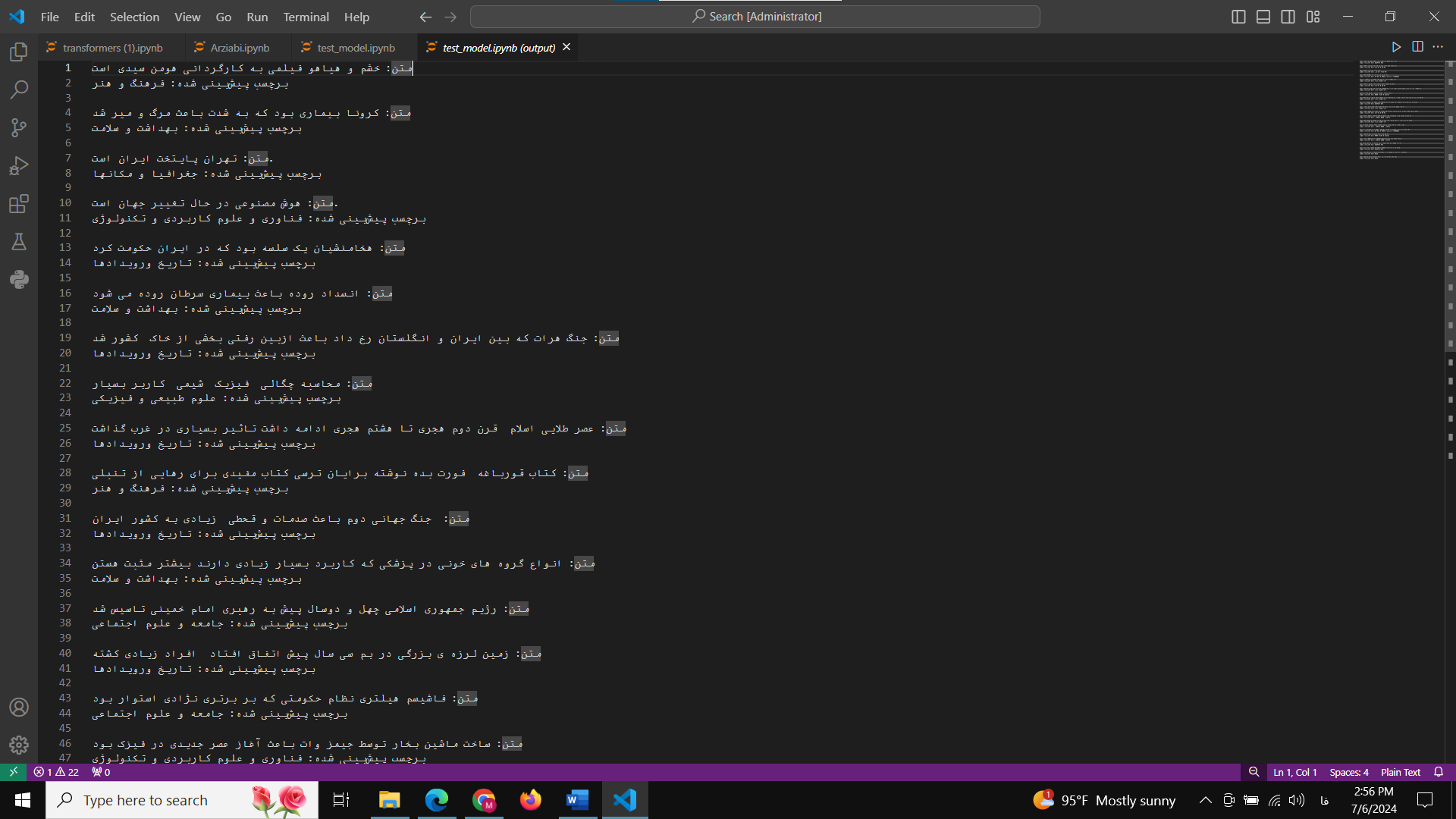

چگونگی پیادهسازی Mixup

برای پیادهسازی Mixup در یک مدل عصبی، میتوانید از کتابخانههای یادگیری عمیق مانند PyTorch یا TensorFlow استفاده کنید. در این کتابخانهها، توابعی برای اعمال ترکیب Mixup بر روی دادهها و برچسبها در دسترس هستند.

import torch

import torch.nn.functional as F

def mixup_data(x, y, alpha=0.2):

lam = np.random.beta(alpha, alpha)

batch_size = x.size()[0]

index = torch.randperm(batch_size)

mixed_x = lam * x + (1 - lam) * x[index, :]

y_a, y_b = y, y[index]

return mixed_x, y_a, y_b, lam

def mixup_criterion(criterion, pred, y_a, y_b, lam):

return lam * criterion(pred, y_a) + (1 - lam) * criterion(pred, y_b)

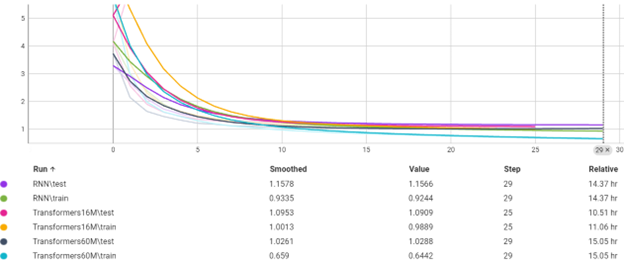

نتیجهگیری

Mixup به عنوان یک روش توسعه دادههای آموزشی در یادگیری عمیق، نقش مهمی را در بهبود عملکرد مدلها ایفا میکند. با افزودن تنوع به دادههای آموزشی و کاهش افتراق نمونهها، مدلهای آموزش دادهشده با Mixup میتوانند بهبود قابل توجهی در عملکرد خود داشته باشند.

اگر درس هوش مصنوعی یا یادگیری عمیق را میخوانید، بهتر است با Mixup آشنا شوید و آن را در آزمایشات خود امتحان کنید. این تکنیک میتواند به عنوان یک ابزار قدرتمند برای بهبود توانمندی مدلهای یادگیری عمیق در تعمیم به دادههای جدید عمل کند.

با تشکر از وقتی که صرف خواندن این بلاگ پست کردید. امیدوارم که اطلاعات ارائه شده، شما را با Mixup و تأثیرات مثبت آن آشنا کرده باشد.

سوالات :

1- کدام مورد از اهداف Mixup نیست ؟

الف ) توسعه تنوع دادههای آموزشی

ب) بهبود عملکرد مدل ها برای دادههای ناشناخته

ج) تولید برچسبهای تصادفی

د) امکان جداسازی تصاویر ترکیب شده

2- ایدهی اصلی MixUp چیست ؟

الف ) تکیه بر تولید تصاویر ساده

ب) امکان حذف نویز با استفاده از تکنیکهای نوین

ج) استفاده از دادههای خام برای ورودی شبکه عصبی

د) ترکیب کردن برچسبها و استفاده در ورودی شبکه عصبی

3- کدام مورد ربارهی MixUp صحیح است ؟

الف ) از کتابخانههای Tf یا pyTorch استفاده می شود

ب) دادههای خام، خروجی این تکنیک است

ج) دادههای ترکیبی، ورودی این تکنیک است

د) لامبدا، یک عدد دقیق و غیر تصادفی در فرمول مروبط به MixUp است .